论文 · 选题 · 方法 · 发表

覆盖AI与医疗健康、金融经济、教育、交通、能源、环境科学、社会科学、农业等交叉领域,从选题、方法设计、实验实现到论文撰写与投稿的全流程指导。

涵盖纯CS方向(CV、NLP、数据挖掘、系统架构等)与交叉CS方向(AI+医疗、AI+安全等),辅导 CCF-A/B/C 会议论文的选题、实验、写作与投稿全流程。

针对本科/硕士毕业设计,提供AI方向的选题规划、技术方案设计、代码实现、实验调优、论文写作与答辩准备等全方位辅导。

面向工业场景的AI模型落地,包括设备故障预测、质量检测、需求预测、供应链优化等,提供从数据处理到模型部署的完整技术方案。

专为零基础同学设计,手把手带你完成人生中第一篇科研论文。为保研、留学申请积累核心竞争力,从科研入门到成果产出的全程陪伴式辅导。

已个人辅导 20+ 同学成功申请海外 PhD,覆盖欧洲、香港、澳门、新加坡、澳洲、美国(美国直博居多)。服务包括套磁策略、导师选择、面试辅导、文书撰写(PS/SOP/CV)等全流程申请支持。

以下展示了真实辅导过程中的沟通记录、文件交互与最终成果交付情况,帮助您直观了解从开始到论文发表的完整辅导流程。所有截图均已脱敏处理。

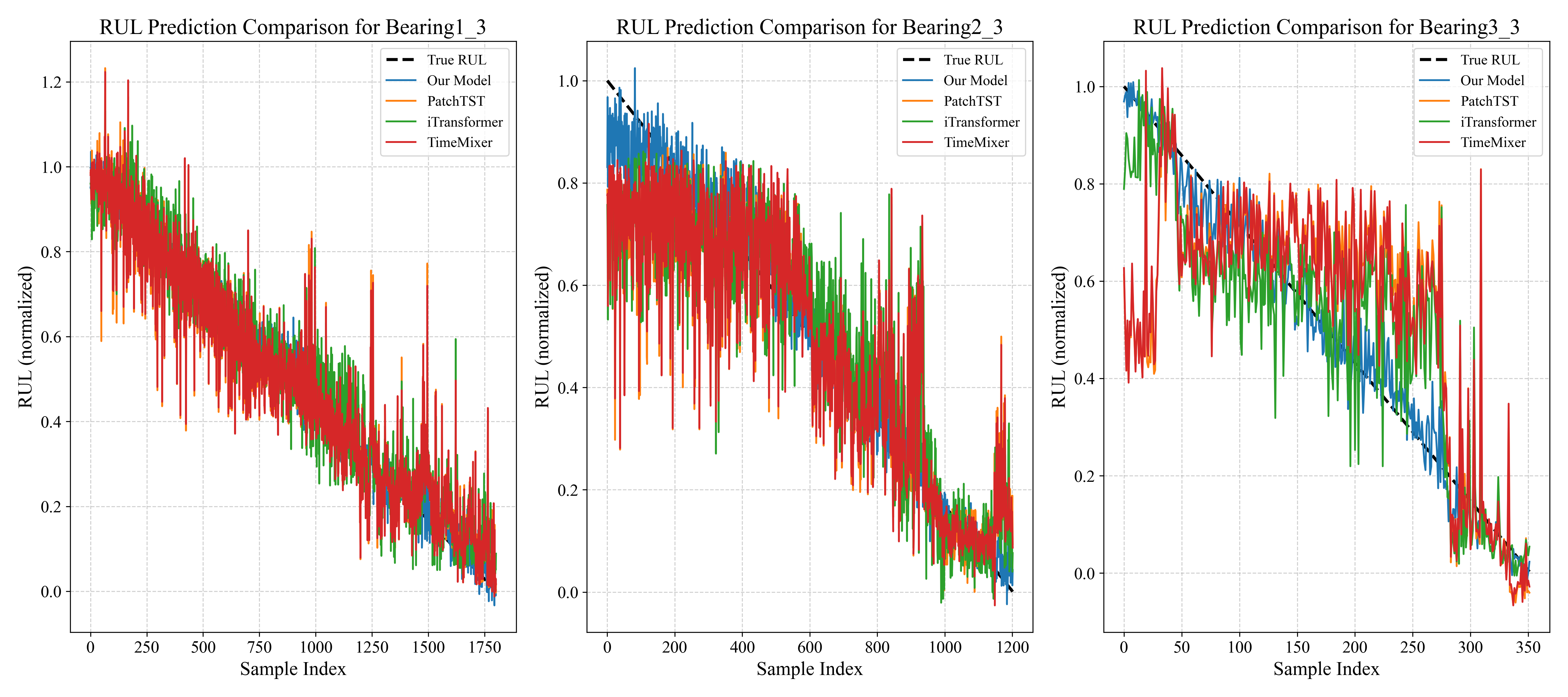

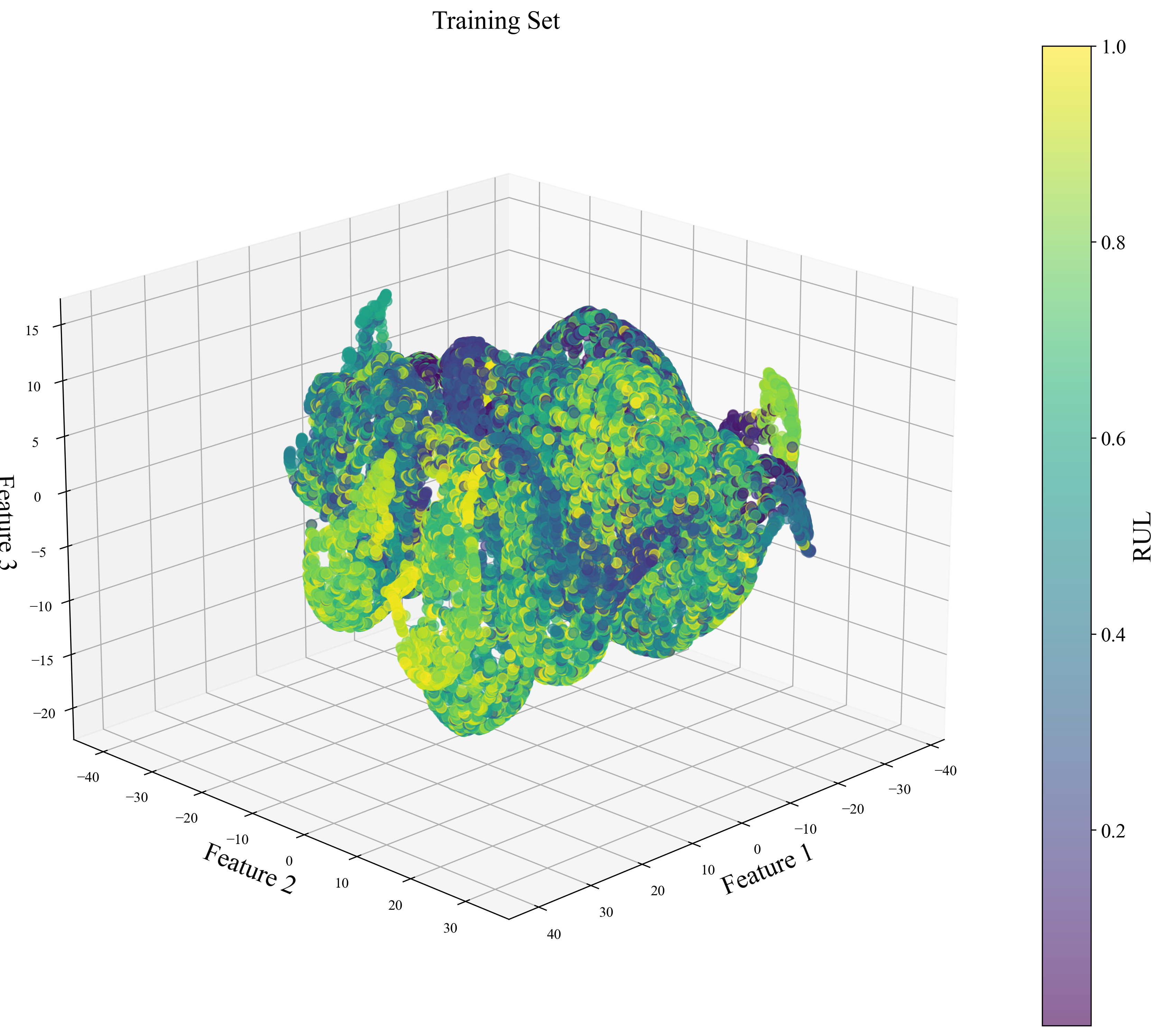

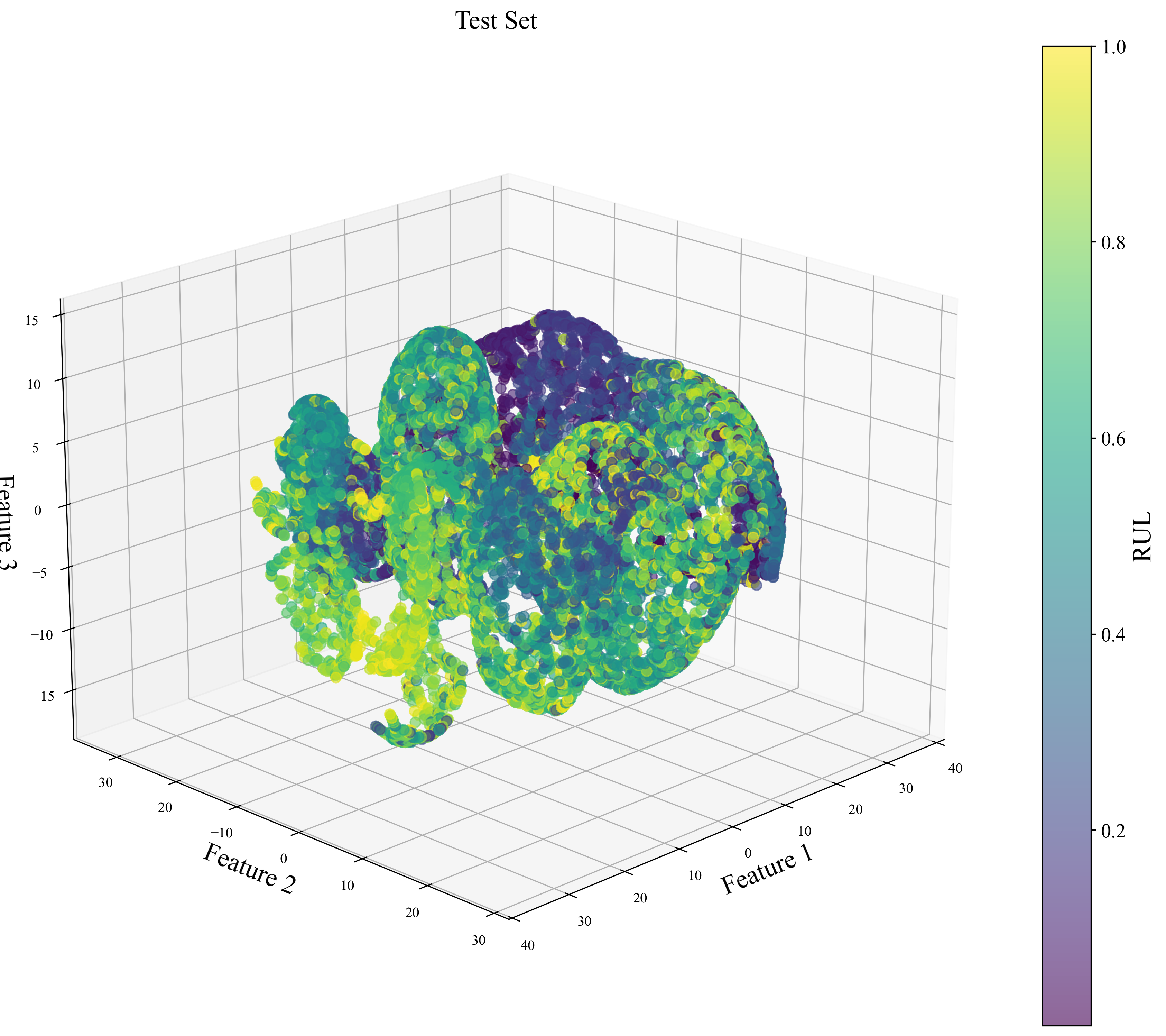

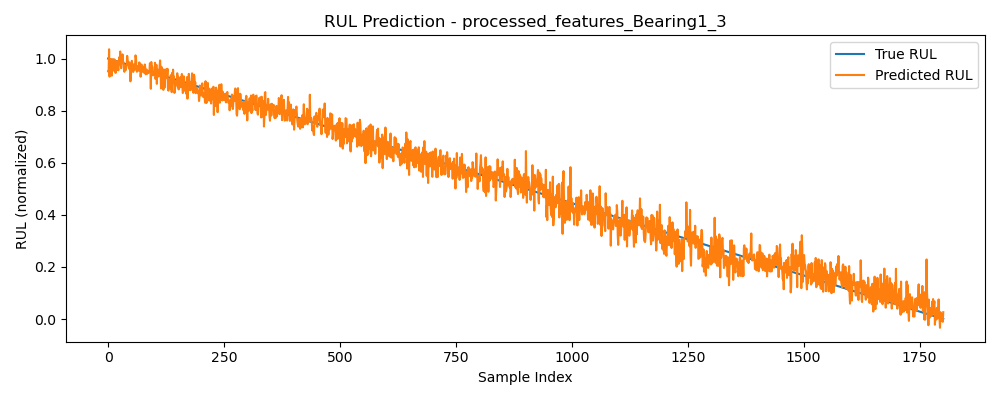

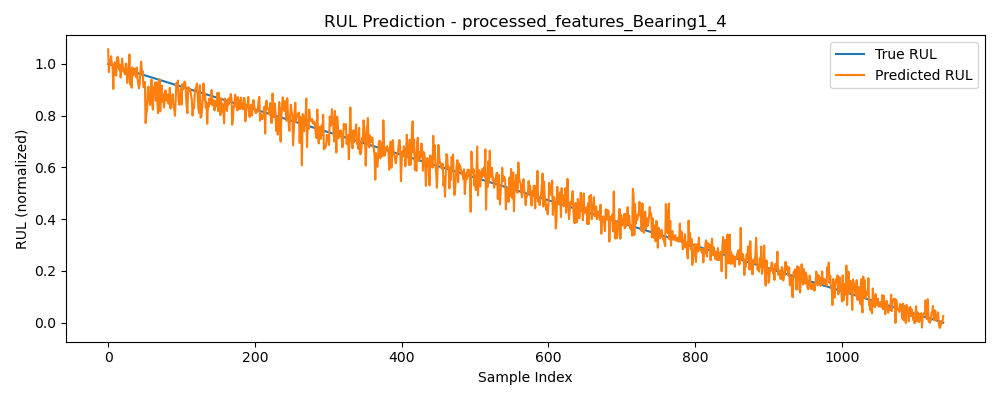

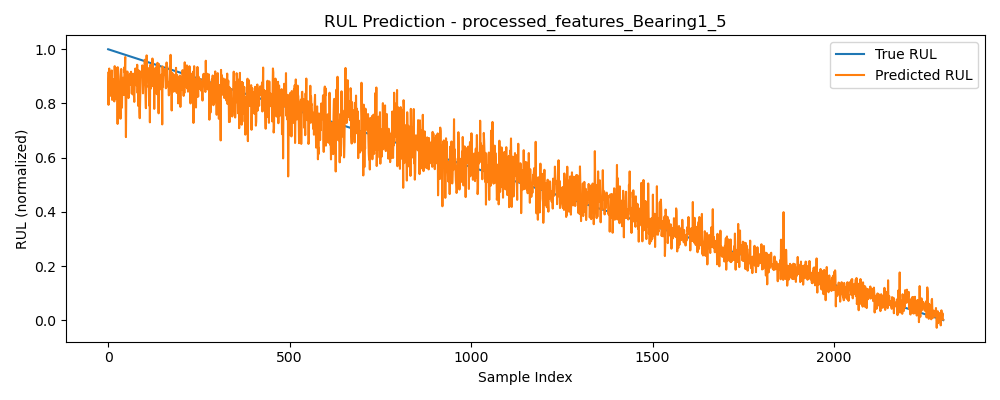

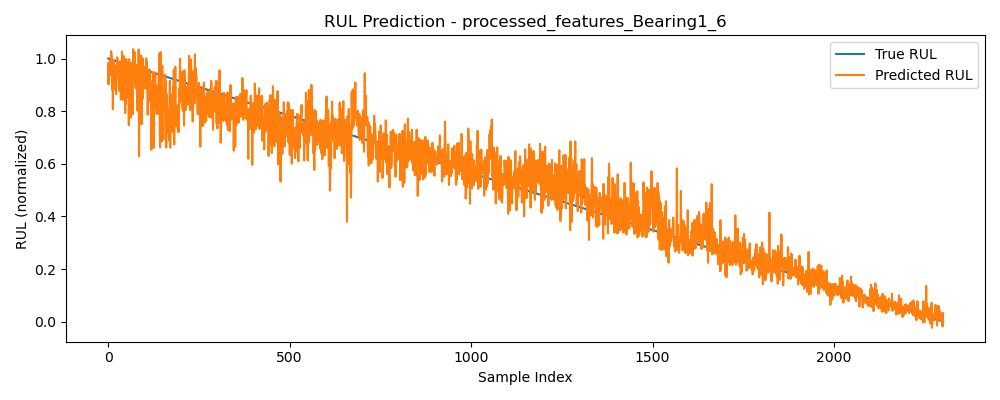

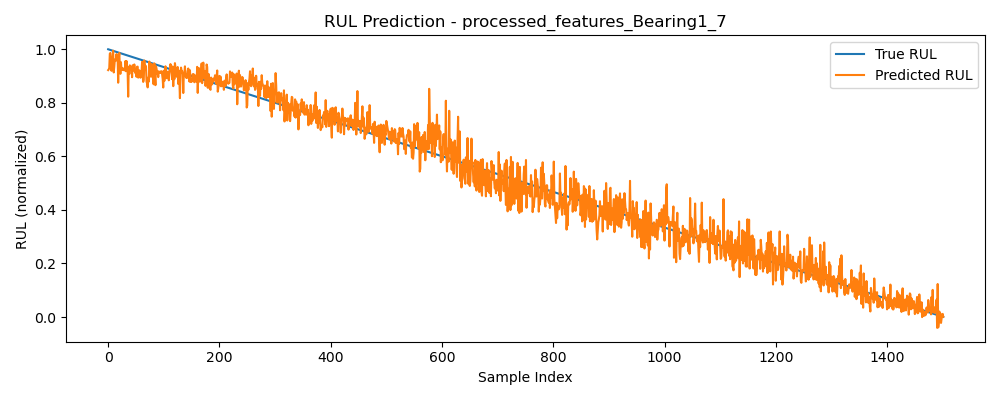

利用振动信号数据进行特征提取与分析,构建轴承剩余使用寿命(RUL)预测模型。通过3D特征可视化和多轴承对比,验证模型的预测效果与泛化能力。

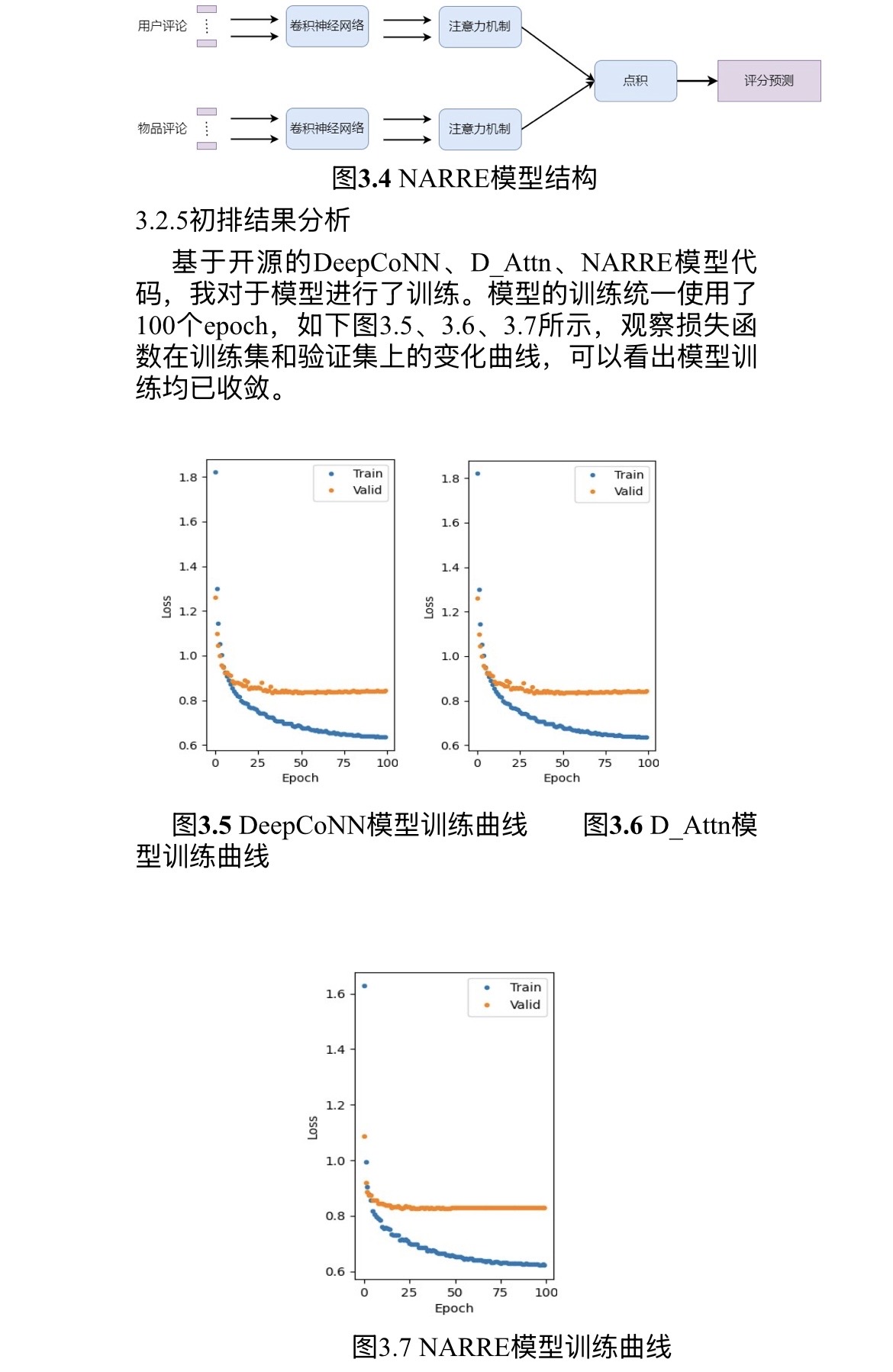

采用 DeepCoNN、D_Attn、NARRE 等基于 Transformer 注意力机制的初排模型,结合 QWEN-max、GLM-4、DeepSeek-V2 等大语言模型进行重排,构建两阶段推荐系统。通过用户评论与物品评论的深度语义理解,显著提升推荐列表质量。

| 组合方式 | 覆盖率 | 召回率 | NDCG | MRR |

|---|---|---|---|---|

| DeepCoNN + QWEN-max | 503 | 0.739 | 0.855 | 0.877 |

| DeepCoNN + GLM-4 | 502 | 0.732 | 0.870 | 0.892 |

| DeepCoNN + DeepSeek-V2 | 503 | 0.745 | 0.879 | 0.933 |

| D_ATTN + QWEN-max | 499 | 0.743 | 0.858 | 0.857 |

| D_ATTN + GLM-4 | 501 | 0.727 | 0.872 | 0.896 |

| D_ATTN + DeepSeek-V2 | 506 | 0.752 | 0.881 | 0.915 |

| NARRE + QWEN-max | 505 | 0.735 | 0.859 | 0.865 |

| NARRE + GLM-4 | 500 | 0.737 | 0.877 | 0.907 |

| NARRE + DeepSeek-V2 | 502 | 0.737 | 0.873 | 0.907 |

| 初排模型或重排组合方式 | 覆盖率 | 召回率 | NDCG | MRR |

|---|---|---|---|---|

| DeepCoNN | 495 | 0.770 | 0.889 | 0.918 |

| DeepCoNN + DeepSeek-V2 | 503 | 0.745 | 0.879 | 0.933 |

| D_ATTN | 493 | 0.775 | 0.889 | 0.925 |

| D_ATTN + DeepSeek-V2 | 506 | 0.752 | 0.881 | 0.915 |

| NARRE | 494 | 0.771 | 0.887 | 0.904 |

| NARRE + DeepSeek-V2 | 502 | 0.737 | 0.873 | 0.907 |

| 用户评论限制长度 | 音乐评论限制长度 | 覆盖率 | 召回率 | NDCG | MRR |

|---|---|---|---|---|---|

| 100 | 50 | 499 | 0.750 | 0.870 | 0.917 |

| 400 | 200 | 506 | 0.752 | 0.881 | 0.915 |

| 1600 | 800 | 507 | 0.741 | 0.865 | 0.904 |

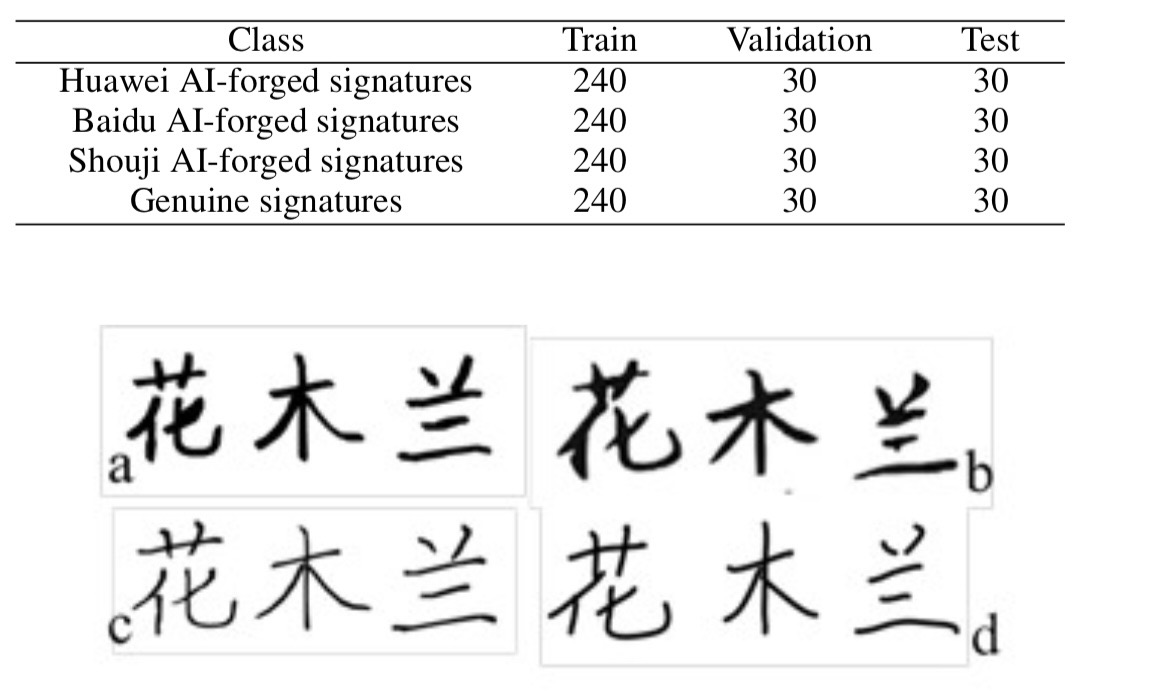

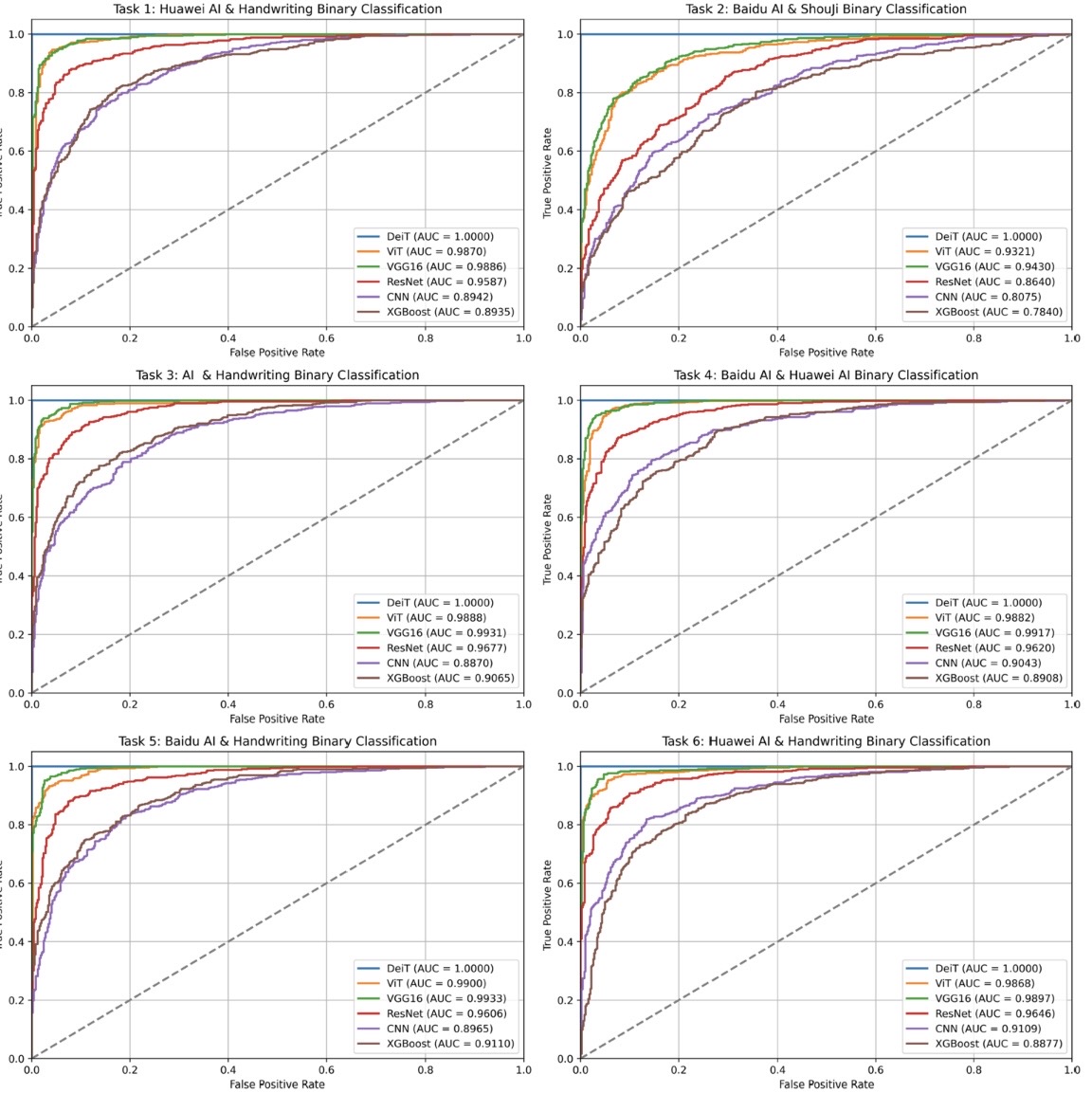

针对 AI 伪造签名的检测问题,采用 DeiT、ViT、VGG16、ResNet、CNN 及 XGBoost 六种模型,在华为 AI、百度 AI、手机 AI 三种伪造签名与真实手写签名之间进行多组二分类实验。DeiT(Data-efficient Image Transformer)在全部六项任务中均达到 AUC = 1.0,展现出卓越的签名真伪判别能力。

| 类别 (Class) | 训练集 (Train) | 验证集 (Validation) | 测试集 (Test) |

|---|---|---|---|

| Huawei AI-forged signatures | 240 | 30 | 30 |

| Baidu AI-forged signatures | 240 | 30 | 30 |

| Shouji AI-forged signatures | 240 | 30 | 30 |

| Genuine signatures | 240 | 30 | 30 |

| 任务编号 | 分类任务 | 正类 | 负类 |

|---|---|---|---|

| Task 1 | Huawei AI & Handwriting | 华为 AI 伪造签名 | 真实手写签名 |

| Task 2 | Baidu AI & Shouji | 百度 AI 伪造签名 | 手机 AI 伪造签名 |

| Task 3 | AI & Handwriting | AI 伪造签名(混合) | 真实手写签名 |

| Task 4 | Baidu AI & Huawei AI | 百度 AI 伪造签名 | 华为 AI 伪造签名 |

| Task 5 | Baidu AI & Handwriting | 百度 AI 伪造签名 | 真实手写签名 |

| Task 6 | Huawei AI & Handwriting | 华为 AI 伪造签名 | 真实手写签名 |

| 模型 | Task 1 | Task 2 | Task 3 | Task 4 | Task 5 | Task 6 |

|---|---|---|---|---|---|---|

| DeiT | 1.0000 | 1.0000 | 1.0000 | 1.0000 | 1.0000 | 1.0000 |

| ViT | 0.9870 | 0.9321 | 0.9888 | 0.9882 | 0.9900 | 0.9868 |

| VGG16 | 0.9886 | 0.9430 | 0.9931 | 0.9917 | 0.9933 | 0.9897 |

| ResNet | 0.9587 | 0.8640 | 0.9677 | 0.9620 | 0.9606 | 0.9646 |

| CNN | 0.8942 | 0.8075 | 0.8870 | 0.9043 | 0.8965 | 0.9109 |

| XGBoost | 0.8935 | 0.7840 | 0.9065 | 0.8908 | 0.9110 | 0.8877 |

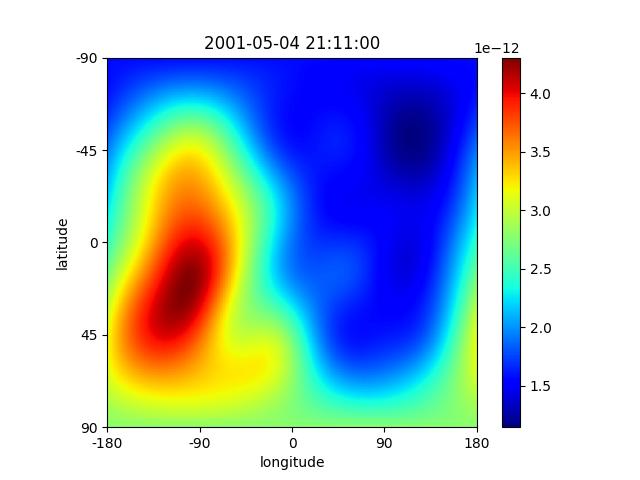

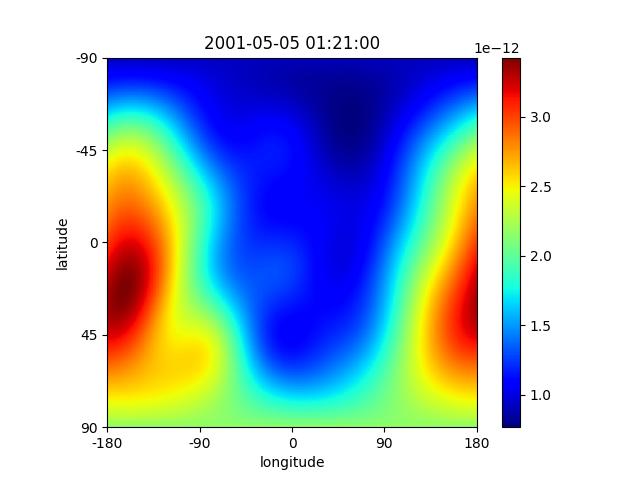

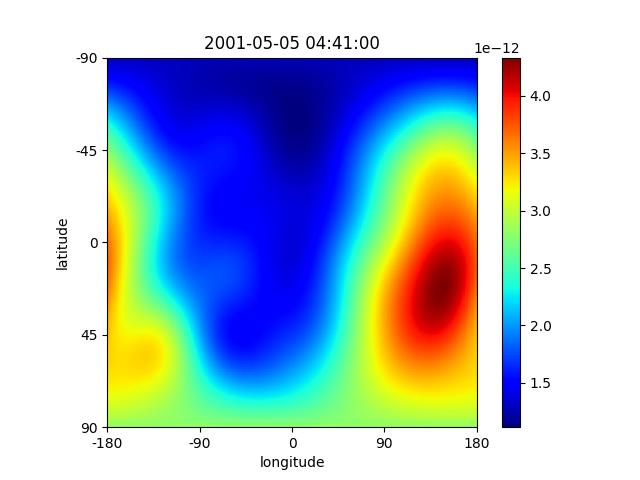

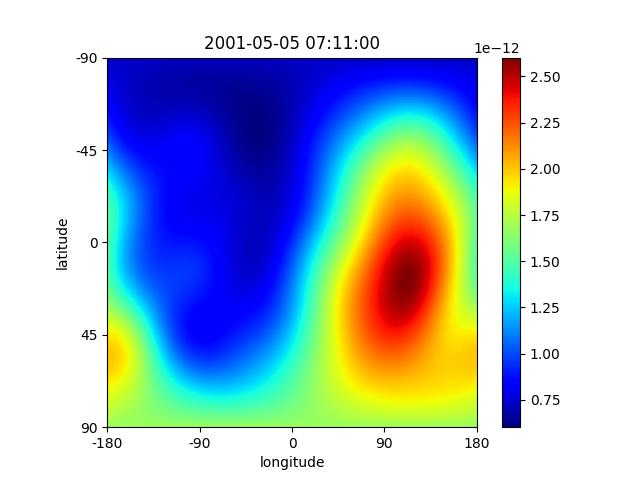

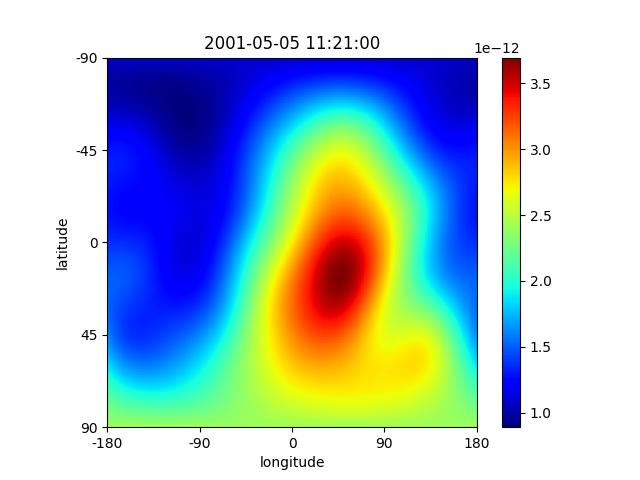

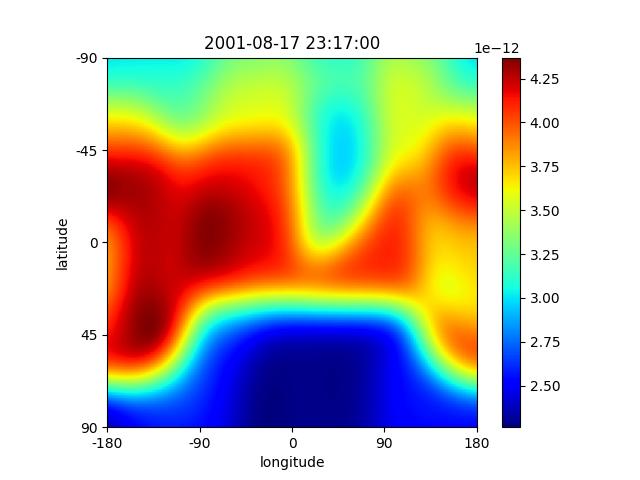

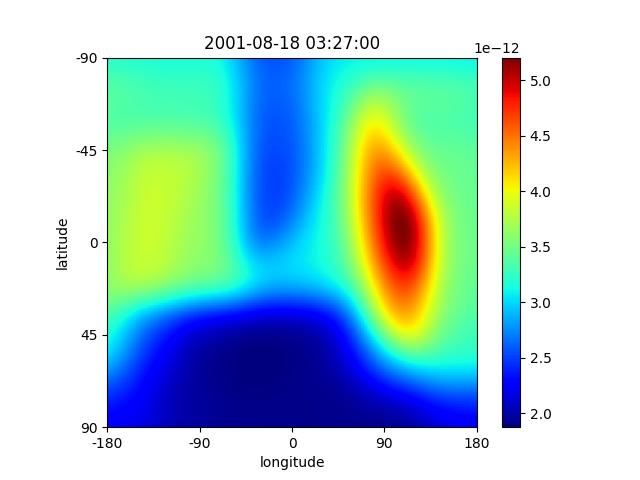

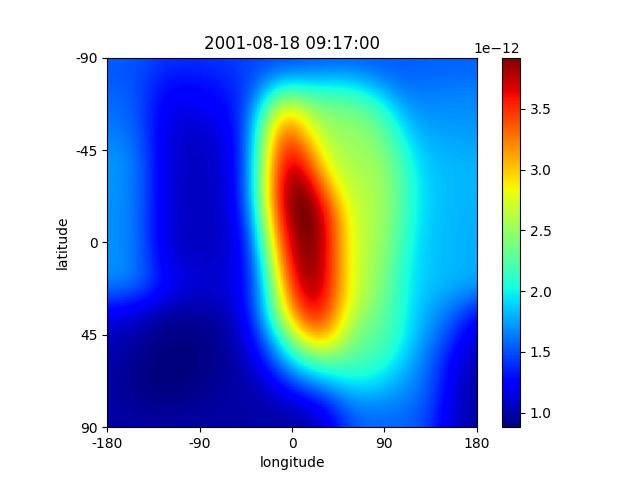

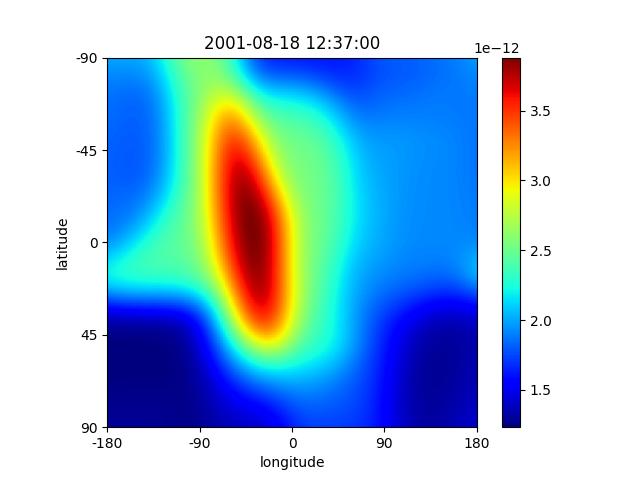

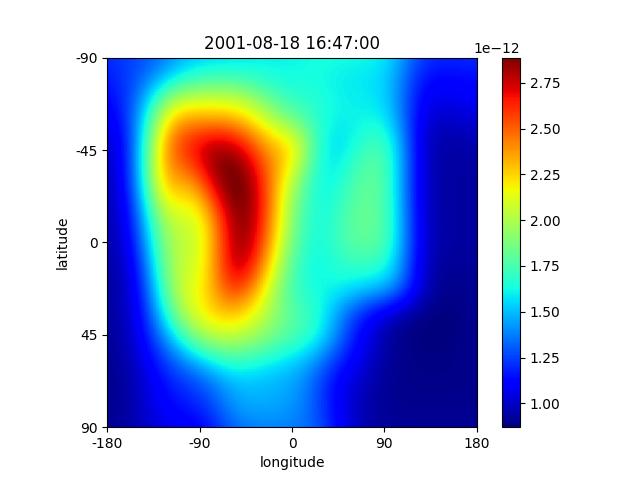

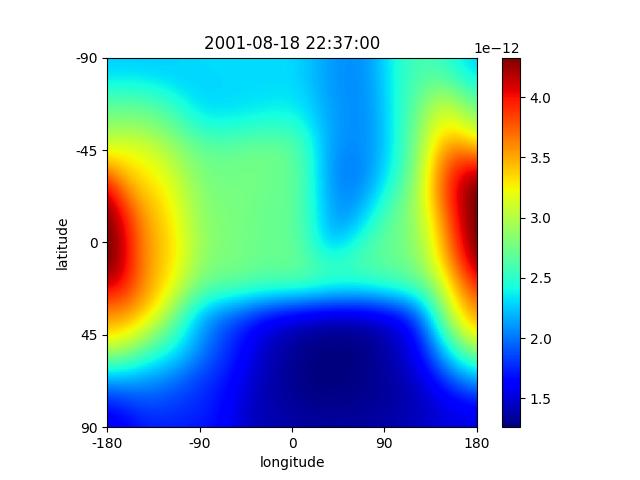

结合物理方程约束(MHD 方程组)与深度学习模型,对太阳表面磁通量分布进行时序预测,实现对太阳黑子运动轨迹与演化过程的高精度建模。

| 模块 | 说明 |

|---|---|

| 输入数据 | SOHO/MDI 卫星全日面磁图(Magnetogram),空间分辨率 2″/pixel,时间分辨率 96 min |

| 物理约束 | 磁流体动力学(MHD)方程组:感应方程、连续性方程、动量方程;确保磁通量守恒(∇·B=0) |

| 网络架构 | 编码器-解码器结构 + 物理残差层,输入历史 T 帧磁图,输出未来 N 帧预测 |

| 损失函数 | L = L_data(MSE 数据拟合)+ λ · L_physics(PDE 残差约束)+ L_boundary(边界条件) |

| 训练数据 | Solar Cycle 23(1996–2008)期间的 SOHO/MDI 观测数据,覆盖多次 M/X 级耀斑事件 |

| 预测目标 | 基于当前时刻及历史 6 帧磁图(约 10 小时),预测未来 24 小时磁通量分布演化 |

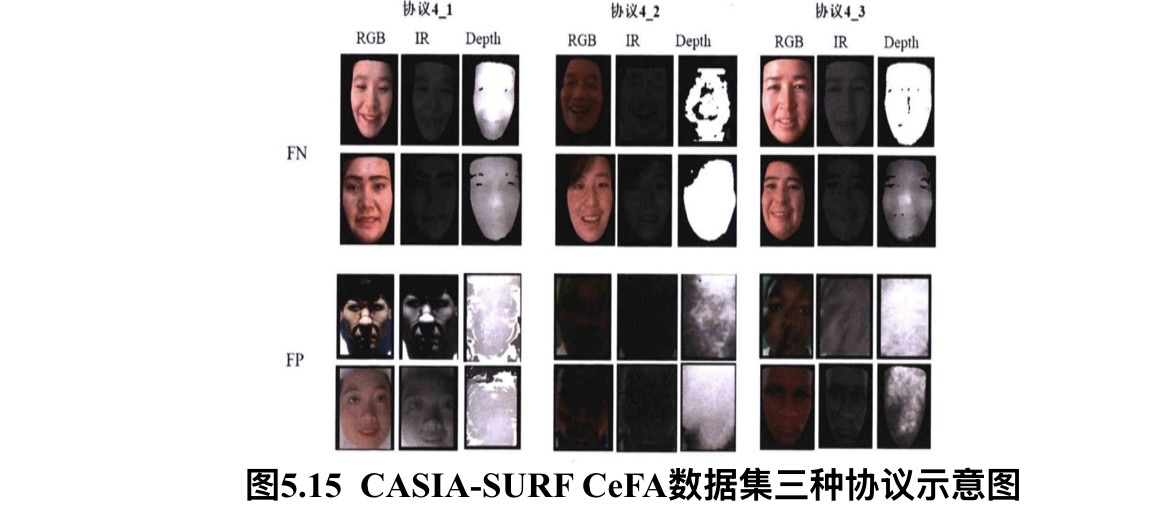

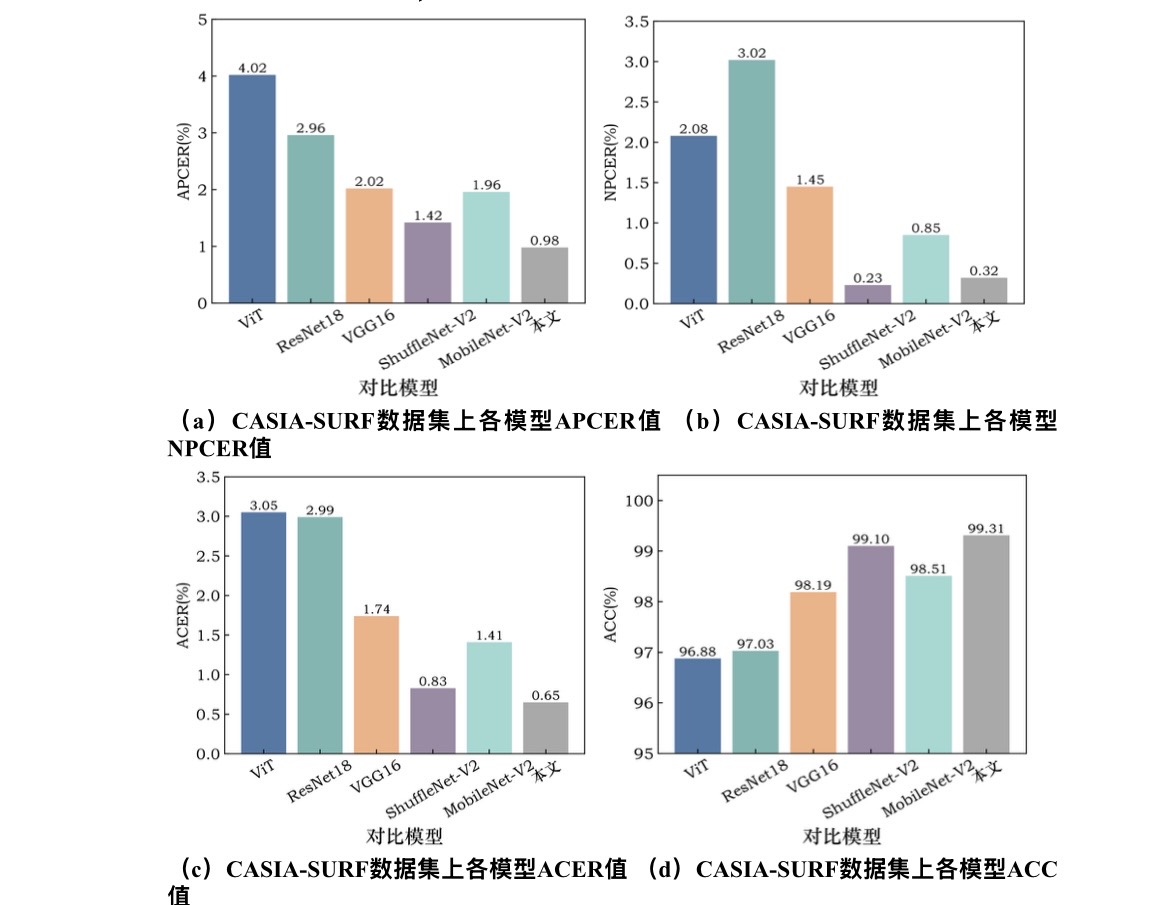

利用 RGB、红外(IR)和深度(Depth)三种模态数据进行人脸反欺骗识别,在 CASIA-SURF CeFA 数据集上实现跨协议泛化,提出的多模态融合方法在所有评估指标上均优于主流基线模型。

| 模型 | APCER (%) | NPCER (%) | ACER (%) | ACC (%) |

|---|---|---|---|---|

| ViT | 4.02 | 2.08 | 3.05 | 96.88 |

| ResNet18 | 2.96 | 3.02 | 2.99 | 97.03 |

| VGG16 | 2.02 | 1.45 | 1.74 | 98.19 |

| ShuffleNet-V2 | 1.42 | 0.23 | 0.83 | 99.10 |

| MobileNet-V2 | 1.96 | 0.85 | 1.41 | 98.51 |

| 本文方法 | 0.98 | 0.32 | 0.65 | 99.31 |

| 模块 | 说明 |

|---|---|

| 输入模态 | RGB 可见光图像 + 近红外(IR)图像 + 深度(Depth)图像,三模态同步采集 |

| 数据集 | CASIA-SURF / CASIA-SURF CeFA,包含多种欺骗攻击类型(打印、视频回放、3D 面具等) |

| 测试协议 | CeFA 协议 4_1 / 4_2 / 4_3,分别测试不同攻击类型与采集条件下的模型泛化能力 |

| 特征提取 | 各模态独立提取特征,利用轻量级骨干网络(如改进的 ShuffleNet/MobileNet)降低计算开销 |

| 融合策略 | 多模态特征融合模块,结合注意力机制动态加权不同模态的贡献,增强判别性特征表达 |

| 分类输出 | 二分类(真实 / 欺骗),采用二元交叉熵损失 + 中心损失联合优化 |

| 评估指标 | APCER(攻击呈现分类错误率)、NPCER(正常呈现分类错误率)、ACER(平均分类错误率)、ACC(准确率) |

利用预训练 Transformer 模型(RoBERTa、CodeBERT、UniXCoder)对漏洞报告正文进行摘要式标题生成,在包含 25,430 条漏洞报告的数据集上,CodeBERT 在 ROUGE-1/2/L 三项指标上均取得最优表现。

| 数据/长度 | 训练集 | 验证集 | ||

|---|---|---|---|---|

| 正文 | 摘要 | 正文 | 摘要 | |

| 数据集个数 | 23300 | 2130 | ||

| 平均字数 | 1314.91 | 74.85 | 1159.48 | 73.78 |

| 最大字数 | 3979 | 128 | 3965 | 109 |

| 最小字数 | 159 | 30 | 125 | 46 |

| MODEL | ROUGE-1 | ROUGE-2 | ROUGE-L |

|---|---|---|---|

| RoBERTa | 33.31 | 24.12 | 33.33 |

| CodeBERT | 36.64 | 26.17 | 33.41 |

| UniXCoder | 28.57 | 19.09 | 26.36 |

| 项目 | 内容 |

|---|---|

| 样例 1:AMD 显示驱动 DMCUB 唤醒漏洞 | |

| 漏洞原报告 | In the Linux kernel, the following vulnerability has been resolved: drm/amd/display: Wake DMCUB before executing GPINT commands [Why] DMCUB can be in idle when we attempt to interface with the HW through the GPINT mailbox resulting in a system hang. [How] Add dc_wake_and_execute_gpint() to wrap the wake, execute, sleep sequence. |

| 原标题 | Linux Kernel Update: Fix for Potential System Hang in AMD Display Driver |

| RoBERTa | Linux Kernel Fixes drm/amd/display Vulnerability by Waking DMCUB Before GPINT Commands |

| CodeBERT | Linux Kernel Patches drm/amd/display Vulnerability with Preemptive DMCUB Wake for GPINT Commands |

| UniXCoder | Cross-Platform Linux Kernel Patch Fixes drm/amd/display Vulnerability via Preemptive DMCUB Wake for GPINT Commands |

| 样例 2:F2FS 空指针解引用漏洞 | |

| 原标题 | F2FS NULL Pointer Dereference Vulnerability Fixed in Linux Kernel |

| RoBERTa | Linux Kernel F2FS Vulnerability Patch: Prevent NULL Pointer Dereference in f2fs_submit_page_write() by Ensuring BIO Validation |

| CodeBERT | Linux Kernel F2FS: Patch for NULL Pointer Dereference in f2fs_submit_page_write() via BIO Validation Fix |

| UniXCoder | Linux Kernel F2FS Vulnerability Patch: Preventing NULL Pointer Dereference in f2fs_submit_page_write() via BIO Initialization Check |

| 模块 | 说明 |

|---|---|

| 任务类型 | 文本摘要 / 标题生成(Abstractive Summarization),从漏洞报告正文生成简洁标题 |

| 数据集 | 25,430 条漏洞报告(训练集 23,300 + 验证集 2,130),正文平均约 1,300 字,标题平均约 74 字 |

| 模型架构 | Encoder-Decoder Transformer,编码器 8 层 + 解码器 8 层,预训练模型 12 层 |

| 输入维度 | 固定输入维度 1024,输出维度 256,词向量维度 512 |

| 预训练模型 | RoBERTa(通用文本)、CodeBERT(代码+自然语言)、UniXCoder(统一跨模态代码表示) |

| 训练参数 | 初始学习率 0.005,Dropout = 0.1,Batch Size = 16 |

| 评估指标 | ROUGE-1(单字重叠度)、ROUGE-2(双字重叠度)、ROUGE-L(最长公共子序列) |

利用 Mamba 状态空间模型对 ICU 患者临床时序数据进行建模,在自贡市第四人民医院(Zigong)和 eICU 两个数据集上实现高精度疾病预测。模型在 AUC、Accuracy、Precision、Recall、F1-score 五项指标上全面超越 CNN、DNN、LSTM 及多种机器学习基线。

| Dataset | Models | AUC | Accuracy | Precision | Recall | F1-score |

|---|---|---|---|---|---|---|

| Zigong | Our model | 0.978±0.074 | 0.945±0.047 | 0.952±0.023 | 0.940±0.042 | 0.946±0.078 |

| CNN | 0.923±0.016 | 0.892±0.041 | 0.885±0.048 | 0.898±0.060 | 0.891±0.085 | |

| DNN | 0.915±0.003 | 0.887±0.031 | 0.879±0.076 | 0.895±0.017 | 0.887±0.053 | |

| LSTM | 0.908±0.070 | 0.875±0.060 | 0.868±0.028 | 0.882±0.026 | 0.875±0.052 | |

| XGBClassifier | 0.941±0.028 | 0.912±0.049 | 0.920±0.052 | 0.905±0.021 | 0.912±0.088 | |

| RandomForest | 0.934±0.022 | 0.907±0.063 | 0.915±0.059 | 0.900±0.016 | 0.907±0.027 | |

| MLPClassifier | 0.918±0.100 | 0.890±0.094 | 0.883±0.006 | 0.897±0.054 | 0.890±0.084 | |

| LogisticRegression | 0.892±0.050 | 0.853±0.085 | 0.847±0.033 | 0.859±0.052 | 0.853±0.005 | |

| SVC | 0.901±0.089 | 0.868±0.002 | 0.861±0.026 | 0.875±0.038 | 0.868±0.042 | |

| eICU | Our model | 0.982±0.090 | 0.951±0.037 | 0.958±0.063 | 0.944±0.001 | 0.951±0.066 |

| CNN | 0.915±0.067 | 0.901±0.045 | 0.910±0.079 | 0.892±0.010 | 0.901±0.030 | |

| DNN | 0.927±0.027 | 0.894±0.077 | 0.903±0.059 | 0.885±0.077 | 0.894±0.030 | |

| LSTM | 0.920±0.020 | 0.887±0.081 | 0.896±0.085 | 0.878±0.010 | 0.887±0.052 | |

| XGBClassifier | 0.903±0.042 | 0.894±0.062 | 0.900±0.014 | 0.889±0.070 | 0.924±0.012 | |

| RandomForest | 0.946±0.050 | 0.917±0.032 | 0.925±0.060 | 0.909±0.004 | 0.917±0.000 | |

| MLPClassifier | 0.930±0.044 | 0.897±0.073 | 0.906±0.059 | 0.888±0.084 | 0.897±0.028 | |

| LogisticRegression | 0.898±0.021 | 0.857±0.090 | 0.851±0.093 | 0.863±0.001 | 0.857±0.073 | |

| SVC | 0.913±0.076 | 0.879±0.010 | 0.872±0.045 | 0.886±0.053 | 0.879±0.058 |

| Cohort | Models | AUC | Accuracy | Precision | Recall | F1-score |

|---|---|---|---|---|---|---|

| 7-day | Our model (Mamba) | 0.950±0.039 | 0.945±0.041 | 0.942±0.033 | 0.940±0.031 | 0.938±0.007 |

| Our model (Mamba2) | 0.940±0.037 | 0.901±0.018 | 0.912±0.025 | 0.881±0.038 | 0.913±0.018 | |

| CNN | 0.880±0.007 | 0.875±0.028 | 0.858±0.021 | 0.862±0.041 | 0.860±0.049 | |

| DNN | 0.860±0.014 | 0.870±0.010 | 0.865±0.001 | 0.878±0.050 | 0.869±0.011 | |

| LSTM | 0.850±0.016 | 0.863±0.002 | 0.861±0.045 | 0.868±0.037 | 0.859±0.012 | |

| XGBClassifier | 0.900±0.032 | 0.835±0.006 | 0.832±0.027 | 0.830±0.035 | 0.831±0.006 | |

| RandomForest | 0.820±0.038 | 0.750±0.019 | 0.752±0.038 | 0.750±0.020 | 0.749±0.021 | |

| MLPClassifier | 0.730±0.027 | 0.670±0.006 | 0.671±0.007 | 0.670±0.043 | 0.669±0.044 | |

| LogisticRegression | 0.720±0.027 | 0.685±0.017 | 0.684±0.011 | 0.684±0.038 | 0.685±0.040 | |

| SVC | 0.780±0.010 | 0.700±0.020 | 0.701±0.039 | 0.700±0.028 | 0.699±0.015 | |

| 14-day | Our model (Mamba) | 0.860±0.032 | 0.850±0.014 | 0.855±0.022 | 0.838±0.019 | 0.825±0.007 |

| Our model (Mamba2) | 0.845±0.039 | 0.830±0.042 | 0.843±0.010 | 0.827±0.039 | 0.799±0.026 | |

| CNN | 0.820±0.018 | 0.830±0.040 | 0.825±0.044 | 0.812±0.045 | 0.815±0.016 | |

| DNN | 0.830±0.009 | 0.840±0.008 | 0.845±0.012 | 0.832±0.006 | 0.825±0.035 | |

| LSTM | 0.790±0.040 | 0.810±0.001 | 0.808±0.016 | 0.795±0.010 | 0.780±0.032 | |

| XGBClassifier | 0.800±0.044 | 0.730±0.009 | 0.730±0.028 | 0.730±0.025 | 0.730±0.012 | |

| RandomForest | 0.760±0.040 | 0.690±0.024 | 0.690±0.020 | 0.690±0.007 | 0.690±0.009 | |

| MLPClassifier | 0.730±0.031 | 0.670±0.005 | 0.672±0.039 | 0.670±0.034 | 0.669±0.015 | |

| LogisticRegression | 0.720±0.010 | 0.685±0.006 | 0.685±0.042 | 0.685±0.018 | 0.685±0.020 | |

| SVC | 0.740±0.042 | 0.680±0.014 | 0.680±0.040 | 0.680±0.039 | 0.680±0.038 | |

| 28-day | Our model (Mamba) | 0.910±0.008 | 0.920±0.009 | 0.915±0.018 | 0.908±0.004 | 0.905±0.045 |

| Our model (Mamba2) | 0.900±0.030 | 0.892±0.036 | 0.930±0.026 | 0.910±0.009 | 0.863±0.020 | |

| CNN | 0.860±0.044 | 0.880±0.032 | 0.875±0.030 | 0.845±0.039 | 0.846±0.046 | |

| DNN | 0.850±0.020 | 0.870±0.011 | 0.865±0.014 | 0.850±0.031 | 0.848±0.047 | |

| LSTM | 0.870±0.029 | 0.875±0.017 | 0.880±0.049 | 0.878±0.048 | 0.870±0.019 | |

| XGBClassifier | 0.850±0.002 | 0.780±0.037 | 0.778±0.009 | 0.778±0.037 | 0.778±0.042 | |

| RandomForest | 0.810±0.002 | 0.740±0.045 | 0.738±0.044 | 0.738±0.014 | 0.740±0.034 | |

| MLPClassifier | 0.770±0.021 | 0.720±0.014 | 0.718±0.025 | 0.718±0.031 | 0.718±0.018 | |

| LogisticRegression | 0.760±0.005 | 0.710±0.039 | 0.708±0.025 | 0.710±0.016 | 0.708±0.002 | |

| SVC | 0.780±0.048 | 0.705±0.044 | 0.705±0.043 | 0.705±0.034 | 0.704±0.018 |

| 模块 | 说明 |

|---|---|

| 模型架构 | Mamba(Selective State Space Model),基于 S4/S6 选择性状态空间机制,线性时间复杂度 |

| 输入数据 | ICU 患者临床时序数据,包含生命体征(心率、血压、体温、血氧等)和实验室检查(肌酐、血小板、白细胞等) |

| 数据集 | Zigong(自贡市第四人民医院)+ eICU(多中心 ICU 数据库),覆盖多种重症患者群体 |

| 预测任务 | ICU 患者疾病预后预测(二分类),分 7 天、14 天、28 天三个时间窗口评估 |

| 对比模型 | CNN、DNN、LSTM、XGBClassifier、RandomForest、MLPClassifier、LogisticRegression、SVC |

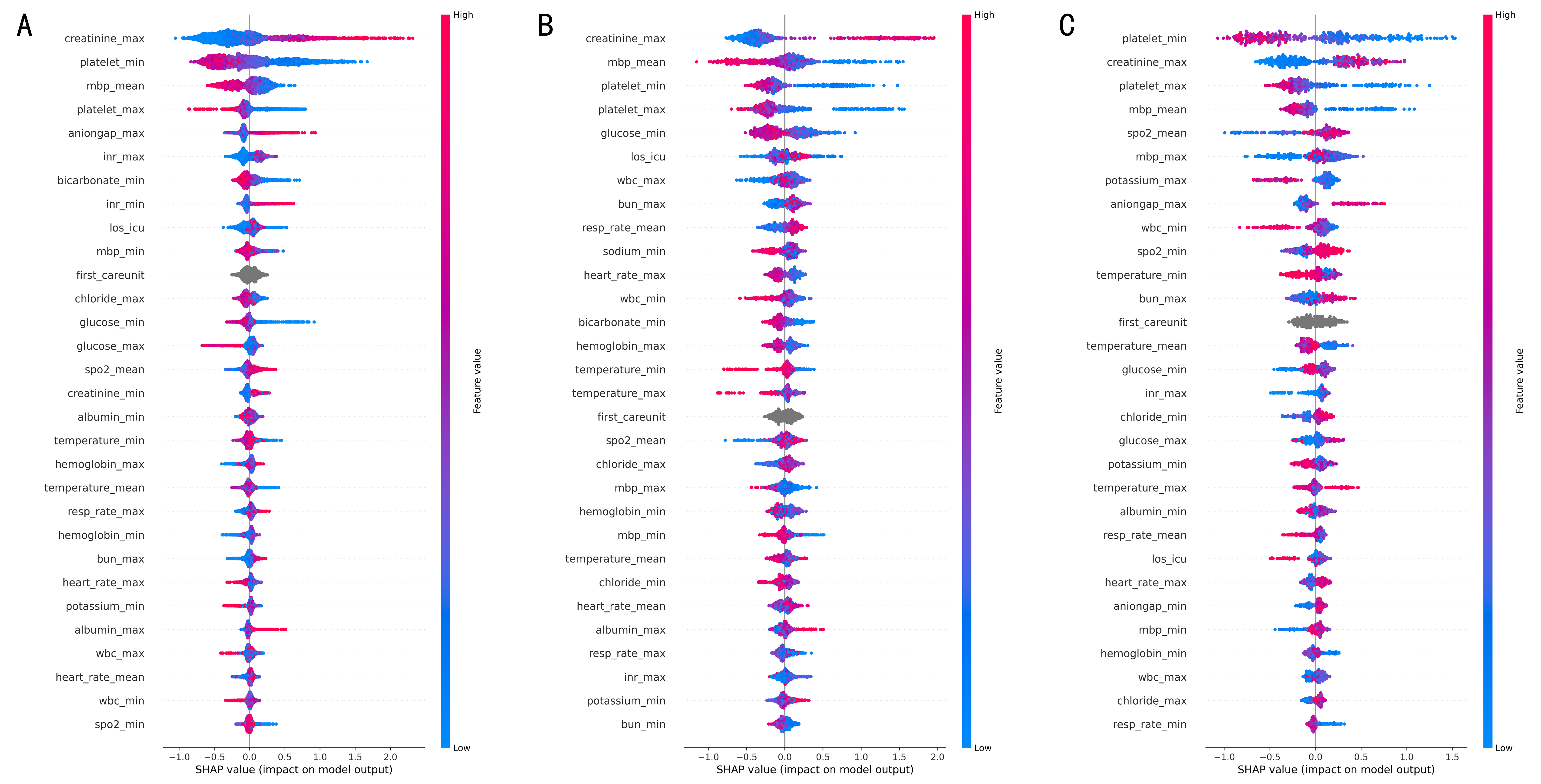

| 可解释性 | SHAP(SHapley Additive exPlanations)特征重要性分析,揭示临床关键预测因子 |

| 评估指标 | AUC、Accuracy、Precision、Recall、F1-score(均报告均值 ± 标准差) |

无论你是刚刚起步、卡在某个环节,还是需要全程陪跑,欢迎来聊。第一次沟通免费,了解你的情况后再决定是否合适。

告诉我你的研究阶段、遇到的问题,以及最紧迫的需求

深入了解你的研究现状,判断症结所在,给出初步建议

根据你的节点和目标,制定针对性的辅导计划与时间安排

每次辅导有记录,进度可追踪,你的成果就是最好的反馈